这篇文章主要总结了下Jiajun Wu他们组有关物理感知/机器人相关的工作,还有些近期的工作,与summary1部分内容相同。

Jiajun Wu 工作

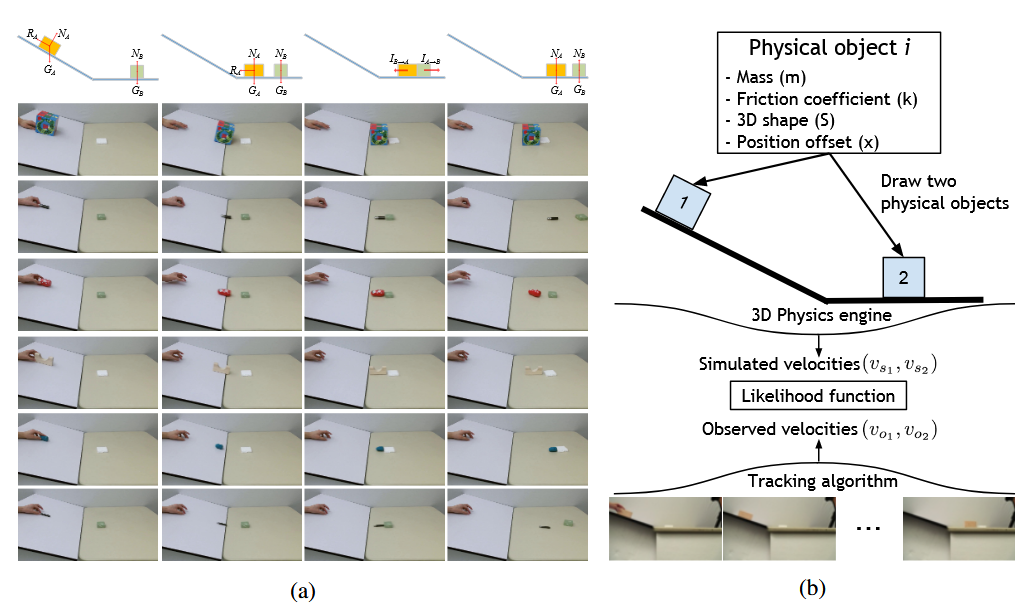

Galileo: Perceiving Physical Object Properties by Integrating a Physics Engine with Deep Learning

2015 NeurIPS

只能输入初始的静态的位置,对一维的摩擦力+动量守恒的规律建模

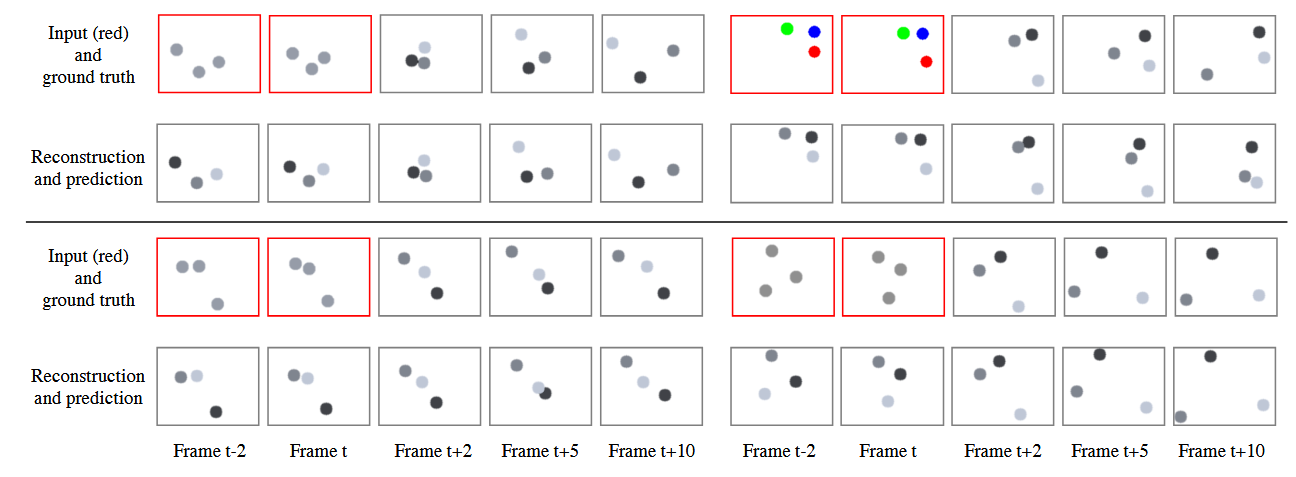

Learning to See Physics via Visual De-animation

2017 NeurIPS(Spotlight)

输入三张图片,两两之间测量速度,预测二维平面上的动量守恒

输入三张图片,两两之间测量速度,预测二维平面上的动量守恒

Physical Primitive Decomposition

2018 ECCV

人们用锤子敲击物体的时候会拿起锤子的柄而非锤子的头,那么当机器人去操作的时候应该如何让它知道这个信息呢?

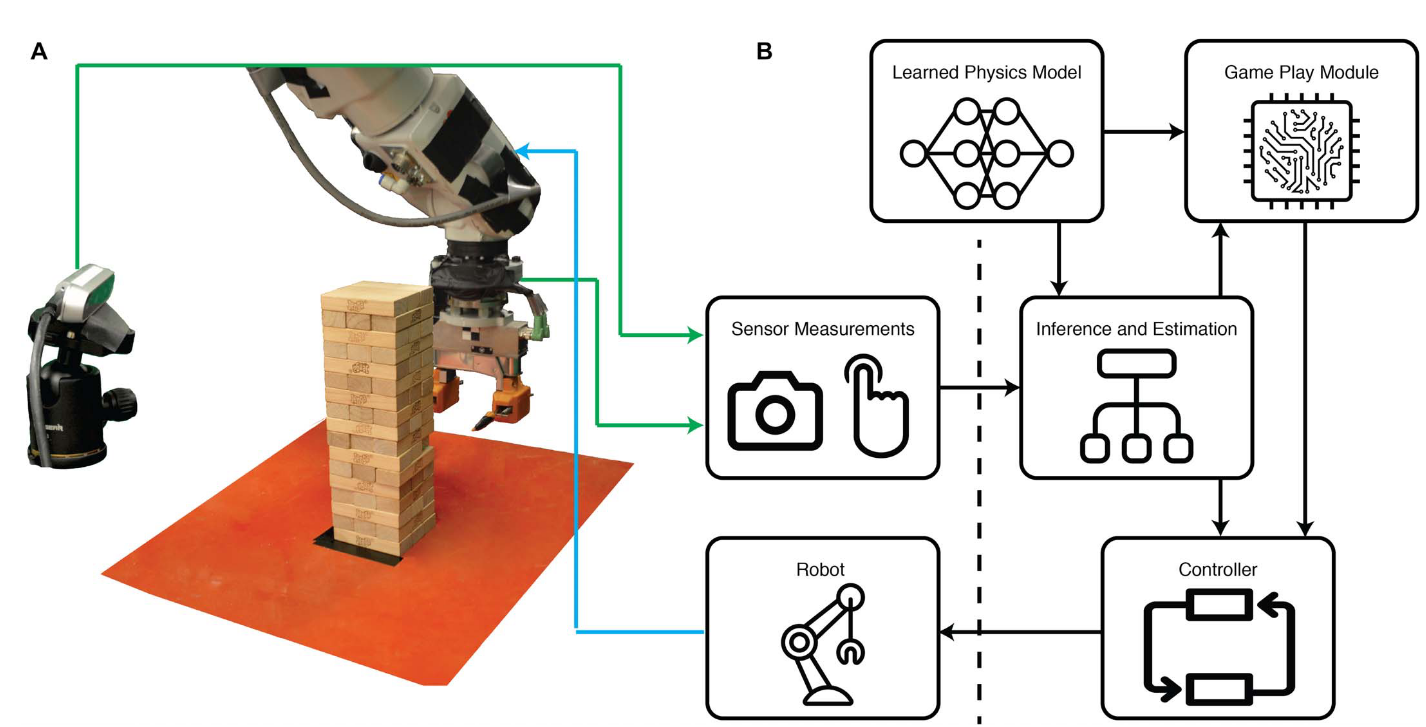

See, feel, act: Hierarchical learning for complex manipulation skills with multisensory fusion

2019 Science Robotics

Learning Physical Graph Representations from Visual Scenes

2020 NeurIPS(Oral)

Unsupervised Segmentation in Real-World Images via Spelke Object Inference

2022 ECCV(Oral)

对真实世界中的物体进行分割

Differentiable Physics Simulation of Dynamics-Augmented Neural Objects

2023 RAL

Physically Grounded Vision-Language Models for Robotic Manipulation

2024 ICRA

近期的一些实验

上次提到了Physdreamer,这应该算是Jiajun组里最新的结果了,简而言之就是给定视频的初始帧,利用生成模型生成视频中物体未来的动作,再用这个生成的结果作为监督信号优化物理场。优点是只需要一张图片作为输入,缺点是生成的视频不符合物理规律。如果考虑到实际机器人的操作的话,其实没必要像他们那样用生成的方式,而应该是比如说机器手自主探索环境中物体受力的影响,学习到一些信息后再进行操作。

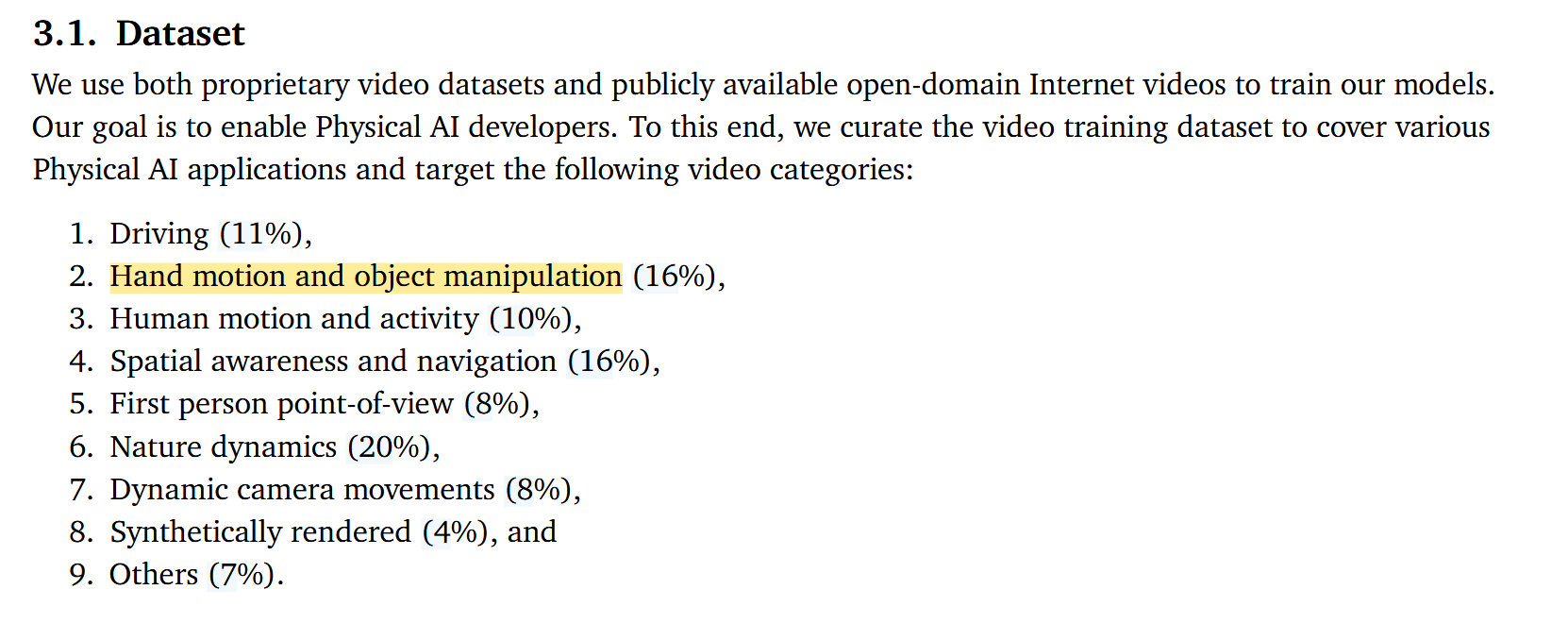

而且我个人觉得视频生成模型在富含物理规律的生成方面做得并不够好,比如Nvidia在今年一月份发布的工作Cosmos应该可以代表目前最强的视频生成模型了(因为堆了很多数据),而且文中还专门提到了他们有很多操作相关的数据。

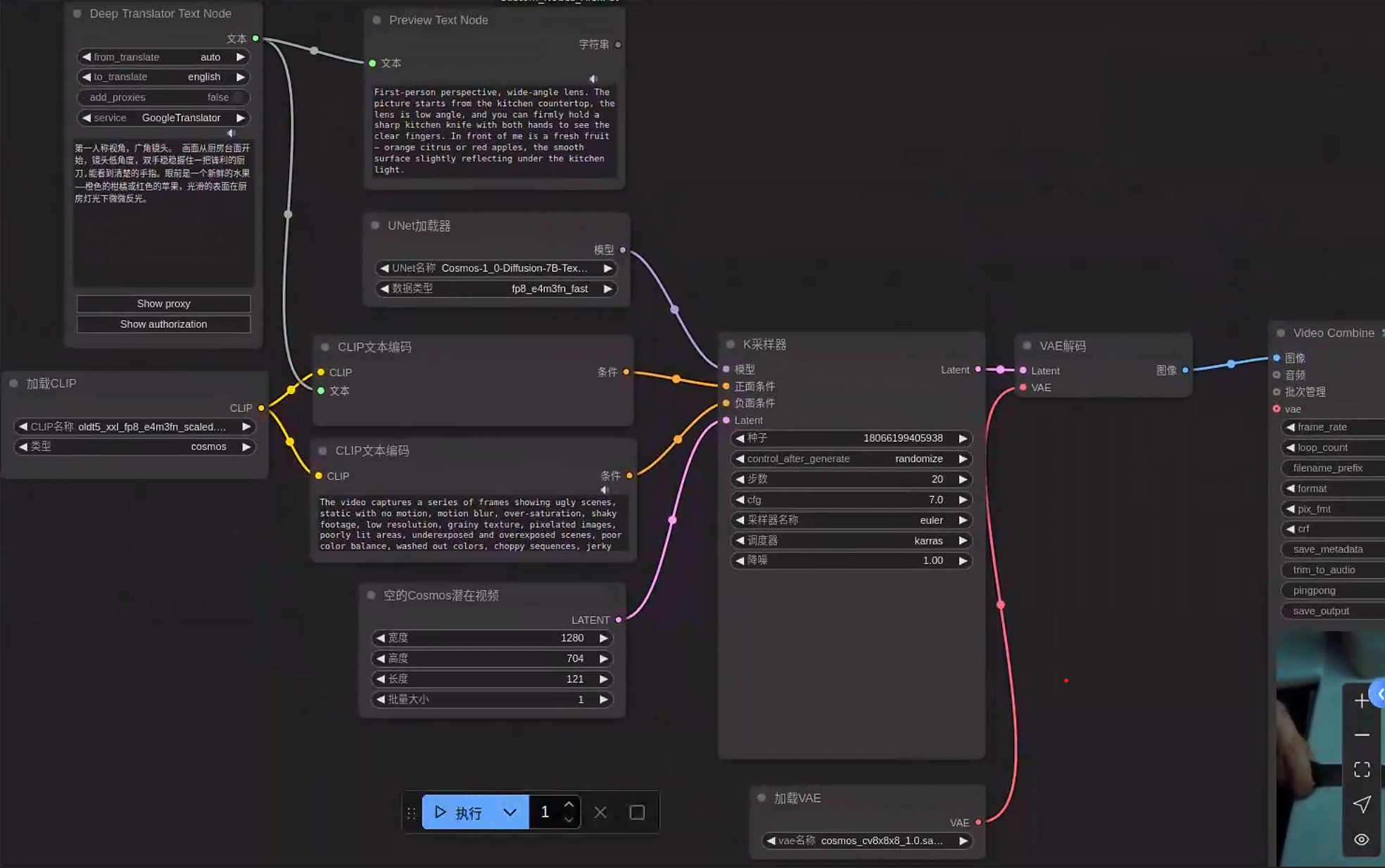

我尝试了下这个模型,工作流如下:

我尝试了下这个模型,工作流如下:

生成1280*704的视频,长度为5秒,部分结果如下:

可以看出,当前模型的效果并不理想。在光影变化和广角视觉效果方面,它已经做得相当不错,能够呈现出较好的视觉效果。然而,在物理场模拟上仍存在明显不足,尤其是在处理流体、爆炸等高度非线性或具有剧烈突变的场景时,表现尤为欠缺。

我认为其中一个关键原因是物理属性的分布方式与像素空间中色彩的分布方式截然不同。色彩在像素空间中的分布通常可以近似为独立同分布(IID),而物理系统中的变量往往存在高度的相互依赖性和因果性。又想到目前许多灵巧手的研究正在采用扩散模型(Diffusion Models)来生成操作轨迹。然而,本质上,这种方法与视频生成的思想是相同的——它依赖于统计概率的相关性,而非物理上的因果律。具体来说,这些模型通常通过学习帧与帧之间的统计相关性,来预测并生成轨迹。但这种方法并不直接考虑物理系统的动力学约束,而是基于数据驱动的方式,在高维概率分布中寻找模式。这类似于视频生成模型如何学习帧与帧或像素之间的关联,而非物理世界中光线传播的真实物理机制。然而,物理系统的演化不仅仅是一个统计问题,更是因果驱动的——例如,在流体动力学、刚体碰撞或柔性物体操作中,每一个状态的变化都严格受偏微分方程或其他物理定律约束,而不是简单的统计相关性。

从这个角度来看,单纯依靠扩散模型生成轨迹,短期内可能在数据拟合上表现不错,但从长期来看,缺乏对物理约束的精确刻画,难以真正提升灵巧手的操作能力。这也是物理仿真不可或缺的原因之一——它能够提供真实的物理约束,使生成的轨迹不仅在统计上合理,而且符合物理因果关系,从而提升机器人操作的可靠性和可推广性。

部分理论解释

一些比较精彩的解释bySora物理悖谬的几何解释(这里还有很多理论我还没看明白,之后多去学习一下)

-

为什么数据点云是低维的,而非占满整个原始数据空间? 因为自然现象满足大量的自然规律,这些规律的限制降低了数据样本点云的维数,而无法占满整个空间。比如,我们考察所有自然人脸照片构成的数据集,每个采样点是一张图片,像素的个数乘以3就是原始图像空间的维数。原始图像空间中的任意一点,都是一幅图片,但是极少的图片才是人脸图片,才会落在人脸图片流形上,因此人脸图片流形不可能占满整个原始图像空间。人脸需要满足很多自然的生理学规律,每个规律都会降低数据流形的维数,例如左右对称,就减少了近一半的像素,都有五官等确定的几何与纹理区域,每个器官的形状类似,描述的参数不多,因此进一步降低维数。最终控制人脸的基因非常有限,由此人脸图片流形的维数远远低于图片像素个数。再如,我们观察平面区域的稳恒态温度分布,由物理热扩散定理,稳定函数满足经典的Laplace方程,由其边界值所唯一确定。如果我们在区域内部有n平方个采样点,在区域边界有n个采样点,那么每个观察到的温度函数被表示为维数为n平方的向量,即原始数据空间维数为n平方,但是实际的流形维数为边界函数的维数n。由此可见,满足物理定律的观察样本构成的数据流形维数远远低于原始数据空间维数。

-

为什么点云集合是流形,即局部是连续光滑的? 绝大多数情形下,物理系统是适定的,但在临界状态下,物理系统会发生突变(由灾变理论或者临界态理论来描述)。物理定律多由偏微分方程系统来描述,微分方程的解由初始值和边界值来控制,系统是适定的,意味着由于能量守恒、质量守恒、能量传递小于光速等物理限制,初边值逐渐变化时,解也随之逐渐变化。在偏微分方程的正则性理论中,这意味着边值的索伯列夫范数控制解的索伯列夫范等等。我们将解视为数据流形上的点,边值视为其对应的局部坐标(即隐空间中的对应隐特征向量)。从数据流形到隐空间的映射被称为是编码映射,从隐空间到数据流形的映射被称为是解码映射。正则性理论保证编码映射和解码映射是连续的乃至光滑的,解的唯一性保证这些映射是拓扑同胚或者微分同胚。边值可以任意局部扰动,即隐变量存在一个开欧式圆盘的邻域。这意味着满足特定物理定则的观察样本构成了数据流形。

-

数据流形上的概率分布如何表示? 关于第三个问题的回答是:用传输变换,将数据概率分布变成计算机可以生成的高斯分布。这个传输变换可以在原始数据空间中进行,也可以在隐空间中进行。常用的传输变换包括最优传输变换和热扩散。我们用流体力学的观点来解释。假设整个隐空间是一个水箱,里面有某种溶剂,其密度为概率密度。我们扰动水箱,使得液体流动起来,使得溶剂密度发生变化。我们计算每个水分子的流向和流速,使得概率密度的熵一直增加,最后就得到高斯分布。例如,我们考虑人脸数据分布,这里每个水分子就是一张人脸图片。我们为人脸图片不断添加噪声,得到一系列图片,直至变成一张白噪声图片。这一系列图片就是水分子的运动轨迹。最后每张人脸图片变成白噪声,所有这些白噪声分布满足高斯分布。这一过程被称为是郎之万的动力学。反过来,给定一张白噪声,我们沿着水分子轨迹倒溯源头,就得到一张人脸图片。这就是扩散生成模型的原理(diffusion model)。当然,也可以直接用最优传输理论求解隐空间到自身的同胚,将数据分布变成高斯分布,这需要求解蒙日-安培方程。由此可见,数据分布的所有信息都由传输映射所包含,而传输映射被一个深度网络来表达。

-

在Sora生成的视频中,每一帧都异常逼真,但是当老奶奶吹了生日蜡烛的时候,蜡烛的火苗纹丝不动。如果我们将视野缩小到每一个令牌的区域,我们看到美轮美奂的真实画面,令牌之间的衔接也非常平滑自然,但是当相距较远的令牌之间有因果联系的时候,即吹出的空气影响火苗的跳动时,两个令牌之间的物理因果没有体现出来。这意味着Transformer用以表达令牌之间的统计相关性,无法精确表达物理因果律。虽然transformer可以在一定程度上操纵自然语言,但自然语言无法准确表达物理定律,而物理定律目前只有偏微分方程才能精密表达。这反应了基于概率的世界模型的某种局限性。

-

自然界的绝大多数物理过程都是稳恒态与临界态的交替变化。在稳恒态中,系统参数缓慢变化,容易获取观察数据;在临界态中(灾变态),系统骤然突变,令人猝不及防,很难抓拍到观察数据。因此,临界态的数据样本非常稀少,几乎在训练集中零测度。由此,Sora系统学习到的数据流形,绝大多数都是由稳恒态的样本所构成。物理过程中的临界态样本多分布在数据流形的边界。因此,在生成过程中,Sora非常容易生成稳恒态的视频片段,但是往往跳过临界态。但是在人类认知中,最为关键的观察恰恰是概率几乎为零的临界态。